cortex技术教程:从入门到实践

Cortex是一款开源的、用于构建和管理机器学习推理服务的强大平台,它能够帮助开发者轻松部署模型,实现高效的推理服务编排,本文将详细介绍Cortex的核心概念、架构设计、安装部署、基本使用方法以及进阶实践,帮助读者快速掌握这一技术工具。

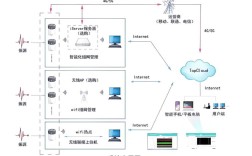

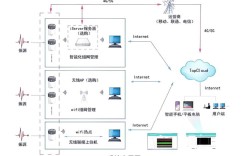

Cortex的核心架构由多个关键组件构成,其中最核心的是API网关、控制器和工作节点,API网关负责接收外部推理请求,进行路由分发和负载均衡;控制器则负责管理整个集群的部署状态,协调各个组件的运行;工作节点是实际执行模型推理的地方,可以水平扩展以应对高并发需求,这种分层架构设计使得Cortex具有高度的可扩展性和容错性,能够满足大规模生产环境的需求。

在开始使用Cortex之前,需要先完成环境准备工作,确保本地或云环境中已经安装了Docker和Kubernetes(minikube可用于本地测试),可以通过Cortex提供的安装脚本快速部署一个开发环境,安装完成后,可以通过cortex version命令验证安装是否成功,还需要配置好Docker Hub或其他容器镜像仓库的访问权限,因为部署模型时会需要推送和拉取镜像。

Cortex的核心使用方式是通过YAML配置文件来定义推理服务,一个基本的配置文件包含多个关键部分:api(定义API端点)、model(指定模型文件和依赖)、compute(配置计算资源)等,以一个简单的图像分类模型为例,配置文件可能需要指定模型文件路径(如model.onnx)、预处理函数、后处理函数以及所需的GPU资源,Cortex支持多种框架,包括TensorFlow、PyTorch、ONNX等,开发者可以根据实际需求选择合适的框架。

在资源管理方面,Cortex提供了灵活的配置选项,compute部分可以精确控制CPU、内存、GPU等资源的分配,还可以设置实例数量和自动扩缩容策略,可以通过设置min_instances: 2和max_instances: 10来确保服务至少保持2个实例运行,并在负载增加时自动扩展至最多10个实例,这种细粒度的资源控制有助于优化成本和性能。

对于需要处理复杂推理流程的场景,Cortex提供了pipeline功能,通过pipeline,可以将多个模型串联起来,实现端到端的推理流程,在一个文本处理任务中,可以先使用NER模型识别实体,再使用情感分析模型判断情感倾向,pipeline的配置需要在YAML文件中定义各个模型的输入输出关系,并确保数据格式的一致性。

监控和日志是保障推理服务稳定运行的重要手段,Cortex集成了Prometheus和Grafana,可以实时监控服务的各项指标,如请求延迟、错误率、资源利用率等,所有推理请求的日志都会自动收集到ELK(Elasticsearch, Logstash, Kibana) stack中,方便开发者进行问题排查,通过这些监控工具,可以快速定位性能瓶颈或异常请求。

在实际部署过程中,版本管理和灰度发布是常见需求,Cortex支持多版本部署,可以在配置文件中指定不同的版本标签,并通过API网关的路由规则实现流量分流,可以将10%的流量导向新版本,其余流量保持旧版本,在验证新版本稳定性后再逐步切换全部流量,这种渐进式发布策略可以有效降低发布风险。

下面通过一个表格总结Cortex中常用的配置参数及其说明:

| 参数名 | 类型 | 说明 | 示例 |

|---|---|---|---|

| api | dict | 定义API端点和路径 | api: path: /predict |

| model | dict | 指定模型文件和依赖 | model: path: ./model.pkl |

| compute | dict | 配置计算资源 | compute: gpu: 1 |

| min_instances | int | 最小实例数 | min_instances: 2 |

| max_instances | int | 最大实例数 | max_instances: 10 |

在进阶实践中,Cortex还支持自定义预处理和后处理逻辑,开发者可以通过编写Python函数来实现数据的格式转换和结果解析,这些函数会被打包到Docker镜像中并在推理时调用,在处理图像数据时,可以在预处理函数中实现图像缩放和归一化操作,在后处理函数中将模型输出的logits转换为概率值。

对于需要大规模部署的场景,Cortex可以与Kubernetes的原生功能深度集成,通过使用Kubernetes的HPA(Horizontal Pod Autoscaler)可以实现基于CPU利用率或自定义指标的自动扩缩容;通过配置Kubernetes的Service可以实现对推理服务的负载均衡;通过设置Resource Quota可以限制资源使用量,避免资源争抢。

Cortex还提供了丰富的CLI工具,方便开发者进行日常管理操作。cortex deploy命令用于部署新版本的服务,cortex logs命令用于查看日志,cortex get命令用于查看服务状态,这些命令大大简化了运维工作,提高了开发效率。

相关问答FAQs:

-

问:Cortex支持哪些机器学习框架? 答:Cortex支持多种主流机器学习框架,包括TensorFlow、PyTorch、ONNX、Scikit-learn、XGBoost等,开发者可以根据自己的模型选择合适的框架,并在配置文件中指定相应的依赖和环境,对于特殊框架,也可以通过自定义Docker镜像的方式支持。

-

问:如何优化Cortex推理服务的性能? 答:优化Cortex推理服务性能可以从多个方面入手:合理配置计算资源,确保有足够的CPU和GPU资源;使用模型量化或剪枝技术减小模型体积;优化预处理和后处理逻辑,减少计算开销;通过设置适当的实例数量和缓存策略来提高并发处理能力,定期监控性能指标,及时发现和解决瓶颈问题也是优化的重要环节。