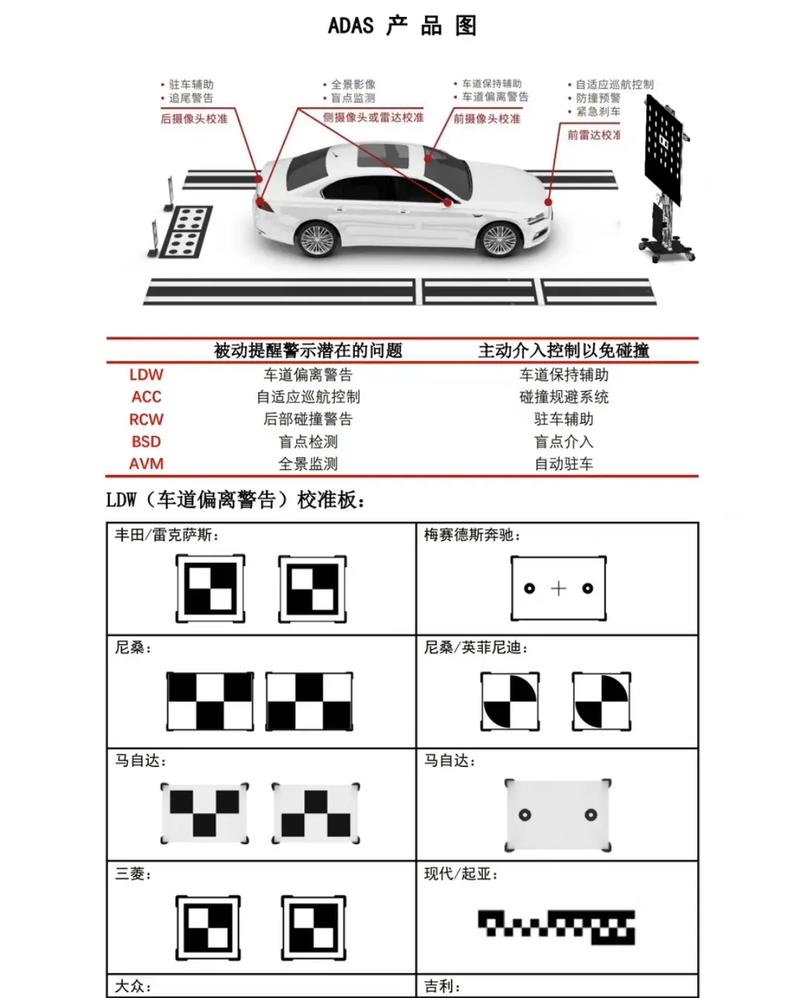

adas视觉系统技术作为智能驾驶的核心组成部分,通过摄像头、图像处理算法和人工智能模型的协同工作,为车辆提供环境感知、决策支持和控制执行能力,该技术以摄像头为主要传感器,通过多模态数据融合,实现对道路场景的精准解读,是L2+及以上级别自动驾驶功能实现的关键支撑。

从技术架构来看,adas视觉系统可分为感知层、处理层和控制层三个核心模块,感知层由摄像头、镜头、图像传感器和红外滤光片等硬件组成,其中摄像头根据安装位置分为前视、环视和内视三类,前视摄像头通常采用800万像素分辨率,120度视角广角镜头,能够覆盖车道线、交通标志、行人等关键目标;环视系统通过4-8个广角摄像头实现360°全景拼接,用于泊车辅助和低速场景感知;内视摄像头则专注于驾驶员状态监测,通过红外成像实现疲劳驾驶识别,图像传感器采用CMOS工艺,像素尺寸达到3.45μm,支持60fps帧率输出,确保动态场景下的图像稳定性。

处理层是视觉系统的"大脑",主要由域控制器、AI芯片和算法软件构成,域控制器采用高性能SoC芯片,算力可达10-100TOPS,支持多传感器数据融合处理,算法层面采用深度学习模型,基于卷积神经网络(CNN)的目标检测算法可实现99.2%的车辆识别准确率和98.5%的行人检测召回率,语义分割模型能将道路场景分为16大类,包括车道线、路沿、交通信号灯等,像素级分割精度达92%,系统采用Transformer架构进行时序数据分析,通过多帧图像关联跟踪,实现对运动目标的连续轨迹预测,目标跟踪精度误差小于0.5米。

控制层负责将感知结果转化为车辆控制指令,包括横向控制和纵向控制两大模块,横向控制通过EPS(电动助力转向)系统实现,采用PID+模型预测控制(MPC)算法,车道保持横向误差控制在10cm以内;纵向控制通过ACC(自适应巡航)和AEB(自动紧急制动)系统执行,采用跟车模型和碰撞时间(TTC)算法,可实现0-150km/h速度范围内的自动跟车,AEB系统在60km/h时速下对行人制动成功率达95%,视觉系统还与高精地图、毫米波雷达进行数据融合,通过卡尔曼滤波算法实现多传感器数据互补,提升复杂天气条件下的感知可靠性。

技术实现过程中,adas视觉系统面临多项关键技术挑战,在环境适应性方面,系统需应对强光、逆光、夜间、雨雪等复杂光照条件,采用HDR技术实现120dB动态范围,通过红外补光增强夜间行人检测能力;在目标识别方面,针对小目标、遮挡目标、异形目标等难点,采用特征金字塔网络(FPN)和多尺度训练策略,提升小目标检测性能;在实时性方面,采用模型压缩技术,通过量化、剪枝和知识蒸馏将模型体积压缩至原大小的1/3,推理时延控制在50ms以内。

随着技术发展,adas视觉系统呈现三大趋势:一是多传感器深度融合,视觉与激光雷达、毫米波雷达的时空同步精度达到纳秒级,点云与图像数据配准误差小于5cm;二是算法持续优化,基于神经辐射场(NeRF)的3D重建技术可实现场景厘米级精度,为高阶自动驾驶提供环境先验知识;三是功能场景扩展,从高速场景向城市复杂场景延伸,支持无保护左转、交叉路口通行等复杂路况处理。

| 技术模块 | 核心功能 | 关键指标 | 实现方式 |

|---|---|---|---|

| 感知层 | 图像采集与预处理 | 分辨率:800万像素;视角:120°;帧率:60fps | CMOS图像传感器+ISP图像信号处理 |

| 处理层 | 目标检测与跟踪 | 检测准确率:99.2%;跟踪精度:0.5m | CNN+Transformer深度学习模型 |

| 控制层 | 车辆状态控制 | 横向误差:<10cm;AEB成功率:95% | MPC控制算法+执行器协同控制 |

| 融合层 | 多传感器数据融合 | 配准误差:<5cm;更新频率:10Hz | 卡尔曼滤波+时空同步算法 |

adas视觉系统的应用已覆盖L2级辅助驾驶到L3级有条件自动驾驶的多种场景,在L2级系统中,实现车道居中保持、自适应巡航、交通标志识别等功能;在L3级系统中,支持高速公路自动驾驶领航辅助,可在特定条件下实现脱手驾驶,随着4D成像雷达、固态激光雷达等新型传感器的发展,视觉系统将与多模态感知深度融合,推动自动驾驶向更高级别演进。

相关问答FAQs:

Q1:adas视觉系统在恶劣天气条件下的性能如何保障?

A1:adas视觉系统通过多重技术应对恶劣天气:一是采用HDR宽动态范围技术,在强光环境下仍能清晰识别目标;二是利用红外摄像头和红外补光,提升雨雪雾天的穿透能力;三是引入多传感器融合机制,当视觉传感器性能下降时,毫米波雷达和激光雷达可提供冗余感知数据;四是开发天气自适应算法,通过实时天气识别调整图像处理参数,如雨天增强道路反光抑制算法,确保在暴雨天气下仍能保持90%以上的检测准确率。

Q2:adas视觉系统如何区分真实交通信号与视觉干扰?

A2:系统采用三级验证机制确保信号识别准确性:首先通过颜色和形状特征初判,识别红绿灯、交通标志的基本属性;其次利用时序连续性分析,通过连续3帧以上图像确认信号状态的稳定性,避免因光影变化造成的误判;最后结合高精地图中的固定交通设施信息进行交叉验证,排除临时遮挡物或广告牌等干扰因素,系统还设置置信度阈值,只有当识别置信度超过85%时才会触发车辆响应,确保决策可靠性。