人脸识别技术作为一种生物特征识别方式,其核心在于通过计算机视觉和机器学习算法对人类面部特征进行提取、比对和验证,从而实现身份识别或身份确认,这一技术的实现涉及多个学科领域的交叉融合,包括图像处理、模式识别、深度学习等,其技术路径可细分为数据采集、预处理、特征提取、比对匹配以及活体检测等关键环节。

在数据采集阶段,人脸识别系统主要通过高清摄像头、红外摄像头或3D传感器等设备获取面部图像或视频流,不同采集设备适应不同应用场景:可见光摄像头适用于常规光照条件下的识别,而红外摄像头能在低光或夜间环境中通过热成像捕捉面部特征,3D传感器则可获取面部的深度信息,构建三维模型以应对照片、视频等伪造攻击,采集到的原始数据往往受光照角度、姿态变化、遮挡物等因素影响,因此需进行预处理以提升质量,预处理过程包括人脸检测(定位图像中的人脸位置)、对齐(通过眼睛、鼻子等关键点校准人脸姿态)、归一化(调整光照、对比度)以及降噪(去除图像中的干扰信息),这些步骤为后续特征提取奠定基础。

特征提取是人脸识别的核心环节,其目标是从预处理后的面部数据中提取具有区分度且稳定的特征表示,传统方法基于手工设计特征,如局部二值模式(LBP)、方向梯度直方图(HOG)以及Gabor小波等,通过统计面部不同区域的纹理、边缘等信息构建特征向量,这类方法在简单场景下具有一定效果,但对光照、姿态变化敏感,泛化能力有限,随着深度学习的发展,基于卷积神经网络(CNN)的特征提取逐渐成为主流,CNN通过多层卷积和池化操作,能够自动学习面部图像的层次化特征:浅层网络捕捉边缘、纹理等低级特征,深层网络融合五官布局、面部轮廓等高级语义特征,FaceNet、DeepFace等模型通过 triplet loss 或 softmax loss 等损失函数训练,将人脸映射到高维特征空间,使得同一人的不同面部图像在该空间中的距离更近,不同人的距离更远,Transformer 架构也被引入人脸识别领域,通过自注意力机制捕捉面部全局特征,进一步提升对复杂变化的鲁棒性。

特征提取完成后,系统通过比对算法计算待识别人脸与数据库中已注册人脸特征的相似度,比对过程可分为1:1验证和1:N识别两种模式:1:1验证是判断“当前人脸是否为指定身份”,常用于手机解锁、门禁控制等场景;1:N识别则是从大规模数据库中匹配最相似的身份,应用于安防监控、人员查找等场景,相似度计算通常采用余弦相似度、欧氏距离或汉明距离等度量方法,并结合阈值判断是否匹配成功,为平衡安全性与便捷性,系统需设置合理的阈值:阈值过高可能导致漏识(同一人误判为不同人),阈值过低则可能误识(不同人误判为同一人)。

活体检测是人脸识别安全性的重要保障,旨在防止照片、视频、面具等非真人面部信息的欺骗攻击,传统活体检测方法基于静态特征分析,如检测眨眼、张嘴等动作(需用户配合),或通过图像质量评估(如检测屏幕反光、摩尔纹等伪造痕迹),动态活体检测则通过视频流分析面部微表情、血流变化等生理特征,或利用红外/3D传感器检测深度信息判断是否为真人,近年来,基于深度学习的活体检测成为主流,通过训练神经网络区分真实人脸与伪造人脸在纹理、运动、光谱等方面的细微差异,实现无配合、高精度的活体识别,例如通过对抗生成网络(GAN)生成伪造样本,增强模型对攻击的抵御能力。

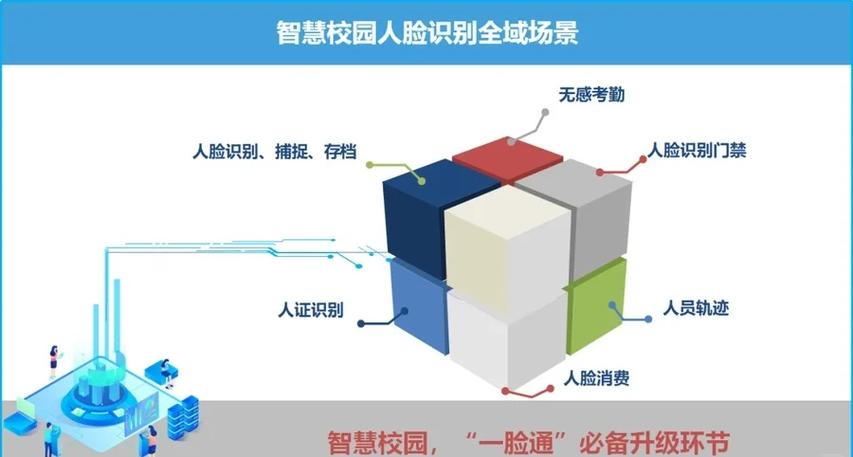

人脸识别技术的应用已渗透到多个领域:在金融领域,用于移动支付、ATM机身份核验;在安防领域,结合监控系统实现嫌疑人员追踪;在智慧城市中,用于公共交通刷脸通行、政务服务身份认证;在医疗行业,通过面部特征辅助患者身份识别,该技术也面临隐私保护、算法偏见(如对不同肤色、性别识别率差异)、数据安全等挑战,需通过技术优化(如差分隐私保护、算法公平性校准)和法规规范(如数据采集授权、使用边界限定)实现健康发展。

相关问答FAQs

Q1:人脸识别在黑暗环境下如何准确工作?

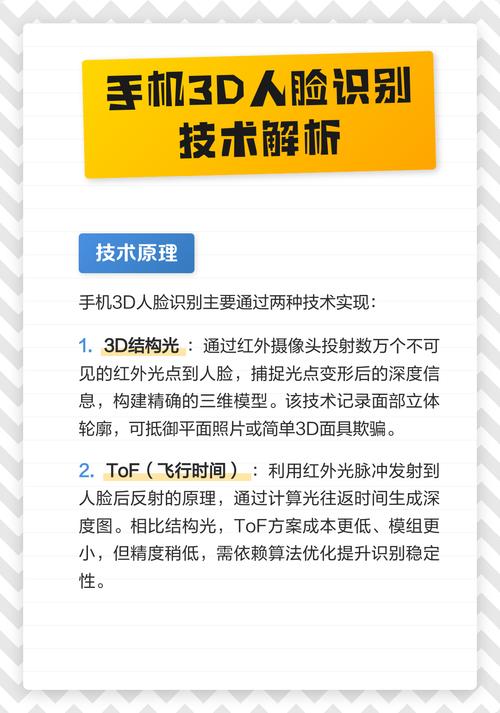

A1:在黑暗环境中,人脸识别系统可通过红外摄像头或3D传感器弥补可见光不足,红外摄像头捕捉面部热辐射形成的红外图像,即使无光也能识别面部轮廓;3D传感器(如结构光、ToF)则通过发射红外光并接收反射信号,构建面部的深度图,不受光照影响,同时可结合活体检测防止红外照片攻击,部分系统会预先训练低光条件下的深度学习模型,增强对暗光图像的特征提取能力。

Q2:人脸识别会误判双胞胎吗?

A2:传统人脸识别技术可能因双胞胎面部高度相似而出现误判,但现代深度学习模型通过细微特征分析(如皮肤纹理、血管分布等微观差异)已显著提升区分度,高精度模型可捕捉双胞胎面部不对称的细节(如痣、疤痕动态变化),或结合多模态信息(如语音、步态)进行交叉验证,实际应用中,误判率通常低于0.1%,但为确保安全性,关键场景仍会辅以其他生物特征(如虹膜识别)进行双重确认。